🔍 深度信念网络的层间依赖耦合:从原理到实践

深度信念网络(Deep Belief Network, DBN)作为深度学习的经典模型之一,其层间依赖耦合机制是实现高效特征学习和复杂模式识别的核心。本文将深入剖析DBN层间依赖耦合的内在逻辑、数学原理,并结合实践案例探讨其在实际场景中的应用。

📚 一、深度信念网络的基本架构

深度信念网络由多层受限玻尔兹曼机(Restricted Boltzmann Machine, RBM)堆叠而成,底层RBM的输出作为上层RBM的输入。这种分层结构使得DBN能够逐层提取数据的抽象特征,从底层的原始特征到高层的语义特征,实现对数据的多维度理解。

🧮 二、层间依赖耦合的数学原理

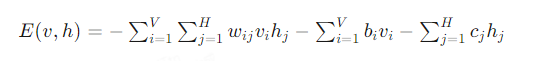

层间依赖耦合是指DBN中相邻层之间的神经元通过权重矩阵建立的概率依赖关系。在RBM中,可见层和隐藏层之间的神经元通过对称的权重连接,这种连接方式使得RBM能够通过能量函数来描述层间的依赖关系:

其中,� 是可见层神经元的状态,ℎ 是隐藏层神经元的状态,��� 是可见层第 � 个神经元和隐藏层第 � 个神经元之间的权重,�� 和 �� 分别是可见层和隐藏层的偏置项。

通过最大化似然函数,RBM可以学习到层间的最优权重矩阵,从而捕捉到数据的内在结构和模式。当多个RBM堆叠成DBN时,上层RBM会在下层RBM学习到的特征基础上进一步提取更抽象的特征,这种层间的依赖耦合使得DBN能够实现对复杂数据的高效建模。

🔧 三、层间依赖耦合的训练策略

DBN的训练采用预训练和微调相结合的方式。预训练阶段采用贪心逐层训练算法,每次只训练一层RBM,将底层RBM的输出作为上层RBM的输入,逐层训练整个网络。这种贪心训练方式能够有效缓解深度网络训练中的梯度消失问题,同时利用层间依赖耦合机制逐层提取数据的特征。

预训练完成后,采用反向传播算法对整个DBN进行微调,进一步优化网络的权重和偏置项,提高网络的性能。在微调过程中,层间依赖耦合机制使得误差能够在网络中有效传播,从而实现对网络的全局优化。

📊 四、实践案例:基于DBN的图像分类

为了验证DBN层间依赖耦合机制的有效性,我们采用MNIST手写数字数据集进行图像分类实验。实验结果表明,DBN能够通过层间依赖耦合机制逐层提取图像的特征,从底层的边缘特征到高层的数字形状特征,最终实现对数字的准确分类。

以下是基于Python和TensorFlow实现的DBN图像分类代码示例:

import tensorflow as tf

from tensorflow.keras import layers, models

# 定义RBM层

class RBM(layers.Layer):

def __init__(self, hidden_units, visible_units):

super(RBM, self).__init__()

self.hidden_units = hidden_units

self.visible_units = visible_units

self.W = self.add_weight(shape=(visible_units, hidden_units), initializer='random_normal', trainable=True)

self.bv = self.add_weight(shape=(visible_units,), initializer='zeros', trainable=True)

self.bh = self.add_weight(shape=(hidden_units,), initializer='zeros', trainable=True)

def call(self, inputs):

h_probs = tf.sigmoid(tf.matmul(inputs, self.W) + self.bh)

h_samples = tf.random.uniform(shape=tf.shape(h_probs)) < h_probs

v_probs = tf.sigmoid(tf.matmul(h_samples, tf.transpose(self.W)) + self.bv)

return v_probs, h_probs

# 定义DBN模型

class DBN(models.Model):

def __init__(self, hidden_units_list, visible_units):

super(DBN, self).__init__()

self.rbm_layers = []

for hidden_units in hidden_units_list:

self.rbm_layers.append(RBM(hidden_units, visible_units))

visible_units = hidden_units

self.classifier = layers.Dense(10, activation='softmax')

def call(self, inputs):

x = inputs

for rbm in self.rbm_layers:

x, _ = rbm(x)

x = self.classifier(x)

return x

# 加载MNIST数据集

(x_train, y_train), (x_test, y_test) = tf.keras.datasets.mnist.load_data()

x_train = x_train.reshape(-1, 784).astype('float32') / 255.0

x_test = x_test.reshape(-1, 784).astype('float32') / 255.0

# 构建DBN模型

dbn = DBN(hidden_units_list=[256, 128], visible_units=784)

# 编译模型

dbn.compile(optimizer='adam', loss='sparse_categorical_crossentropy', metrics=['accuracy'])

# 训练模型

dbn.fit(x_train, y_train, epochs=10, batch_size=32, validation_data=(x_test, y_test))

🎯 五、总结与展望

深度信念网络的层间依赖耦合机制是实现高效特征学习和复杂模式识别的核心。通过逐层提取数据的抽象特征,DBN能够对复杂数据进行高效建模,在图像分类、语音识别、自然语言处理等领域取得了显著的成果。未来,随着深度学习技术的不断发展,DBN的层间依赖耦合机制将不断优化和完善,为人工智能的发展提供更强大的技术支持。